乳腺癌组织病理图像的自动分类是计算机辅助诊断系统的重要任务之一。由于乳腺癌组织病理图像具有类间差异小、类内差异大的特点,提取用于乳腺癌分类的特征比较困难。为了解决这一问题,设计了一种改进的自编码器(AE)网络,该网络使用Siamese框架(孪生框架),可以从组织病理图像中学习有效特征,用于CAD乳腺癌分类任务。首先,对输入图像进行多尺度高斯金字塔处理,得到多尺度特征;其次,在特征提取阶段,使用了孪生框架来约束预训练的自编码器(AE),以确保提取的特征具有较小的类内方差和较大的类间方差。实验结果表明,该方法在BreakHis数据集上的分类准确率高达97.8%。与常用的乳腺癌组织病理学分类算法相比,该方法具有更好、更快的性能。

1. 引言

1.1 深度学习方法

由于组织病理图像的超高分辨率,直接将其输入到深度神经网络是非常昂贵的。常用的方法是使用滑动窗口将它们切割成许多输入图像块。Feng等随机分离斑块,并为其分配原始图像标签。对所有的patch进行分类后,选取每幅图像中单独patch的预测标签,得到图像预测标签。Alom等采用两种方法选择图像patch,一种是从样本中随机裁剪patch,另一种是选择不重叠且顺序的patch。在对图像进行旋转、翻转、剪切、平移等增强后,将图像块输入到一个初始递归残差卷积神经网络(IRRCNN)模型中进行分类。

Sudharshan等人提出了一种将非参数多实例学习与卷积神经网络(Convolutional Neural Networks, CNN)相结合的方法,将图像patch视为一个实例,将整个图像视为一个袋子。与其他将整幅图像标签分配给小块的策略不同,该方法选择对图像中的病变区域进行标记。自然地,如果至少一个补丁被标记为恶性,则图像被标记为阳性,如果图像的任何部分都没有被标记为恶性,则图像被标记为良性。

基于补丁的方法只考虑了补丁内部的信息,而忽略了补丁之间或全局的信息。Yan等人使用双向长短期记忆网络(bidirectional Long - Short-Term Memory network, BLSTM),利用Inception_v3网络对输入图像patch进行特征提取,提出了一种用于分类的混合深度神经网络。将图像patch的特征分时共享到BLSTM中,利用BLSTM的长期依赖关系同时学习patch之间和patch内部的信息。

Sheikh等人提出了一种多尺度输入和多特征网络(Multi-Scale Input and Multi-Feature Network, MSI-MFNET)模型,该模型在提取不同尺度特征的同时学习全局特征和纹理特征。为了评估复杂的生物过程,如多细胞类型迁移和细胞-细胞相互作用,Comes等人提出了一种多尺度生成对抗网络,该网络在多个尺度上执行图像重建,以获得不同尺度的信息,以预测高质量的隔行视频帧。此类视频中帧与帧之间的关系类似于图像补丁之间的关系。然而,组织病理学图像具有类内差异大、类间差异小的特点,这给分类带来了困难。

1.2 自动编码器(AE)

在Siamese框架的约束下,作为特征提取器,并将AE层与SoftMax分类器连接起来,构建用于乳腺癌组织病理图像分类的深度神经网络。

1。由于神经网络的接受野是固定的,在训练过程中不能同时使用全局和局部信息,因此采用多尺度图像作为输入图像。这样,模型可以同时学习粗、细尺度特征,获得更好的分类能力。

2. 设计了AE + SoftMax模型结构,AE通过学习将输入复制到输出,提取有效的输入特征。从而有效地提取特征,避免了特征选择的主观性。而且,模型的训练时间和记忆消耗都远远小于CNN。

3. 为了克服组织病理图像类间方差小、类内方差大的缺点,采用Siamese框架对预训练的AE进行约束。采用改进的对比函数作为损失函数,保证同类图像的特征相似性高,不同类图像的特征相似性低。

2. 材料和方法

2.1.1 自动编码器(Autoencoder)

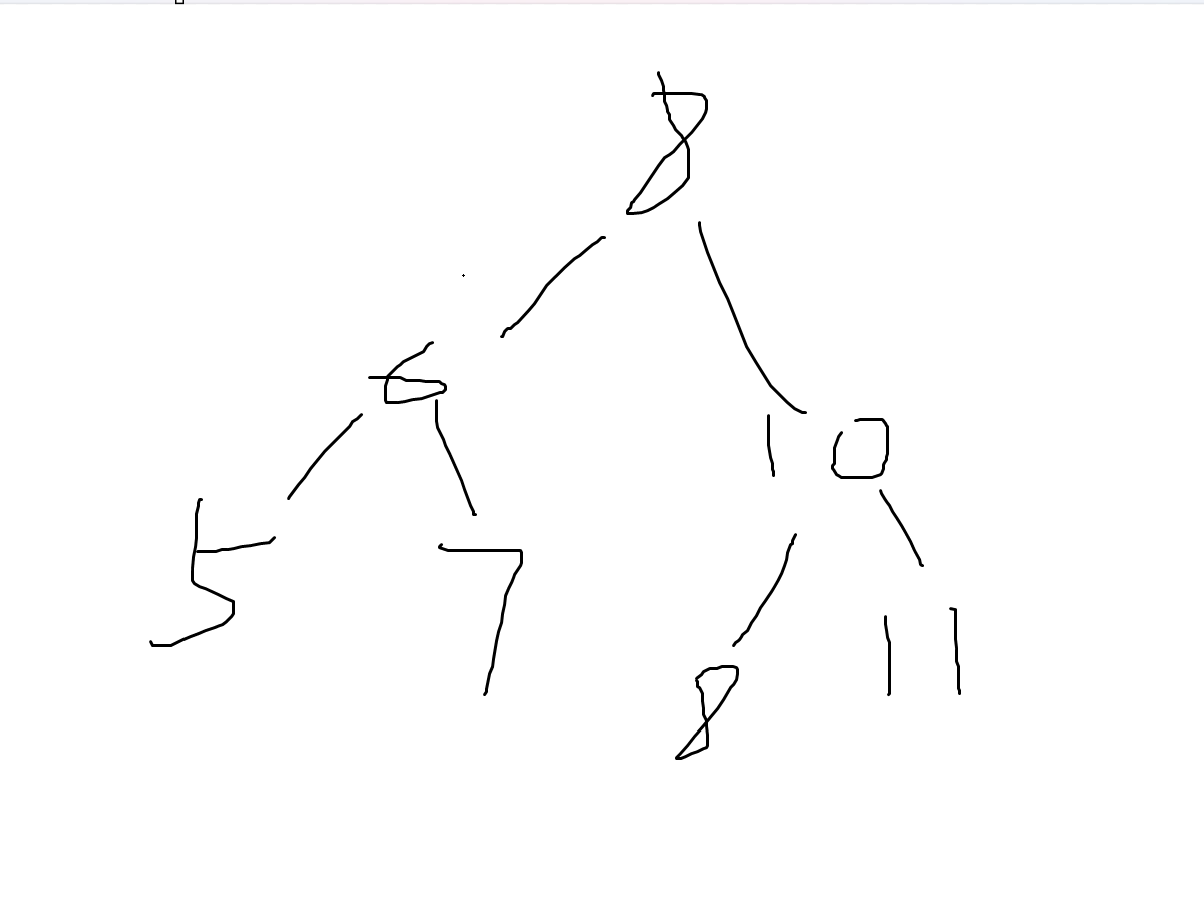

自动编码器是一种对称的神经网络,它以一种无监督的方式训练网络。具体来说,它通过强制输入图像与重建图像相同来学习输入图像的有效特征。如图1所示,每个输入图像的大小为w × h × s,每个输入图像被重构成一维向量。

,

,设

为给定的训练集,其中

为第

张图像的输入向量。

自动编码器将输入作为潜在空间的隐藏表示进行编码,然后将其解码回其原始空间。训练集X的有效特征可以通过最小化输入数据与重构数据

之间的误差来学习。均方误差提供了一种度量输入数据和重构数据之间相似性的度量。损失函数表示为:

训练后,自动编码器的解码器部分被去除,只留下编码器部分作为特征提取器。

自动编码器通过最小化输入数据与重构数据之间的误差来学习数据的有效特征。

自动编码器通过最小化输入数据与重构数据之间的误差来学习数据的有效特征。

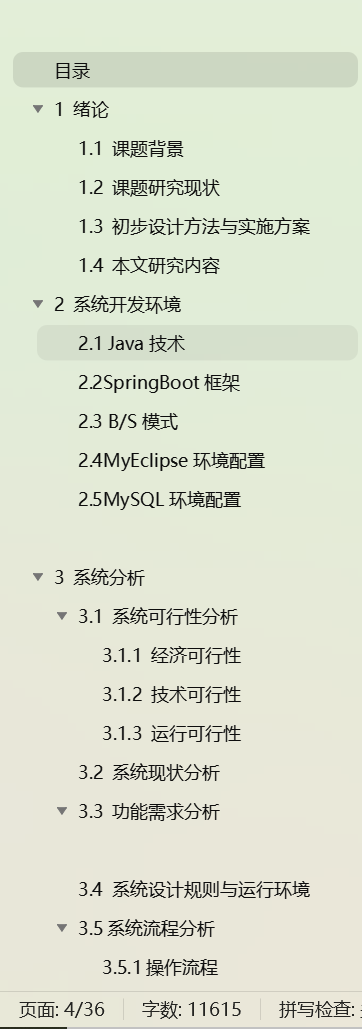

2.1.2 孪生框架

孪生神经网络系统是由两个相同的神经网络组成的神经网络。两个相同的网络共享权重和偏差等参数,但输入的数据不同。通过神经网络的前向传播,可以对原始空间中难以区分的数据进行维度约束,从而提高分类性能。

Siamese网络的架构如图2所示,其中表示特征提取神经网络,

和

分别是

从输入图像

和

中提取的特征向量。特征提取后,通过计算特征向量相似度获得输入图像相似度

2.2 提出的方法

使用多尺度变换进行图像预处理的子框图。用多尺度输入图像对自编码器进行预训练,并以此为基准构建Siamese网络。将图像成对输入到Siamese网络中,并使用对比损失函数对提取的特征进行距离约束。最后,将提取的特征输入到SoftMax分类器中,得到组织病理图像的良性和恶性分类名称。

采用多尺度输入,同时学习不同尺度下组织病理图像的全局特征和局部纹理信息。将图像变换为0.125×、0.25×、0.5×、1×、2× 5个不同的尺度,增强了对图像中重要区域的识别,克服了空间区域在不同尺度下空间区域固定感受野的局限。

2.2.1 多尺度输入

图像尺度不是指图像的大小,而是指图像中的模糊程度。例如,从近距离观看的物体的模糊程度与从较远距离观看的物体的模糊程度不同。图像从近距离移动到远距离也涉及到图像的比例越来越大。当使用机器视觉系统分析未知场景时,计算机不知道图像中物体的大小。因此,为了更好地对特定感兴趣的物体进行分类,有必要找到适合该物体分类的图像尺度描述。

在提取图像特征时,如果采用固定尺度的特征检测,检测结果会偏向于这个尺度,并且会遗漏其他几个尺度特征。为了在不同尺度下检测图像中的相同特征,需要在多个尺度上检测和匹配图像。如图4所示,在粗尺度上更容易识别矩形框架特征,在细尺度上更容易识别圆形框架特征。因此,对输入图像进行多尺度变换。

采用高斯金字塔模型对数据集进行处理和变换。图像的尺度空间定义为原始图像

与二维可变尺度高斯函数

之间的卷积运算。具体来说,尺度空间形式表示为

高斯金字塔的构造包括两个步骤。首先对图像进行高斯平滑处理,然后对图像进行采样处理。

2.2.2 基于自动编码器AE的孪生框架

AE模型具有较好的特征提取效果。但是,如果和

在输入空间中是相邻的,那么在AE特征提取之后,它们在特征空间中的距离应该很小。在对AE进行预训练后,为了减小类内图像之间的距离,增大类间图像之间的距离,基于AE构建了Siamese框架对其进行优化。

使用两个AE,具有共享的权重和偏置参数和不同的输入,作为Siamese网络的基准。对输入图像进行AE处理后,提取其特征向量,在Siamese网络后端进行特征相似度计算。以不同图像中提取的特征相似度为优化目标,训练模型特征提取能力,从图像中提取的类内特征距离尽可能小,类间特征距离尽可能大,以增强分类器性能。

选择该图像创建一个图像对,其中x(i)和x(j)表示不同的输入图像,y(i)和y(j)分别是它们对应的标签。如果x(i)和x(j)属于同一类,则y(ij)= 1,如果x(i)和x(j)不属于同一类,则y(ij) = 0。然后计算

和

之间的欧氏距离,其中以x(i)和x(j)作为输入的网络提取的特征。采用以下损失函数约束特征提取,表示为:

其中D表示特征提取后的图像对的特征距离,前面已经描述了、

和y(ij), m是一个边界参数,用来限制类间距离的最小值。

2.2.3 损失函数

为了更好地约束特征距离,改进了损失函数。根据对比损失公式,当输入图像对属于同一类,正对(y(ij) = 1)时,损失函数可简化为:

当输入的图像对属于不同的类,负对(y(ij) = 0)时,损失函数可简化为:

如果输入的两幅图像属于不同的类别且它们之间的距离大于m,那么就不会产生损失。关键问题是如何选择合适的m值。这通常取决于图像对距离值的范围。如果m设置得过低,那么即使是不同类别的图像也可能因为它们的特征距离较近而被误认为是同一类;而如果m设置得过高,则可能会使得模型难以区分一些实际上距离较近但属于不同类别的图像。 不同图像对之间的特征距离可能具有较大的差异。由于特征对距离的取值范围可能是[0, +∞),直接使用原始距离值可能不太方便。因此,引入了Sigmoid函数来对这个距离值进行归一化,使其映射到一个固定的范围内(通常是[0, 1])。

最终的损失函数定义为:

通过使相似图像特征之间的距离尽可能小,使不同类型图像之间的距离尽可能大来学习组织病理学图像的分类特征。这样可以有效地减少相似组织病理图像提取的特征方差,同时保留不同组织病理图像提取特征的方差,从而使模型更具判别性。使用训练集对AE进行预训练。然后使用预训练的AE形成孪生网络,并通过再训练优化网络参数。为了将组织病理图像划分为两类,构建了三层SoftMax分类器,在Siamese框架约束下对AE网络进行特征提取,得到两类图像的概率分布。网络训练采用交叉熵损失法。

3. 结果

3.1 BreakHis 数据集

BreakHis数据集是最大的公开可用的乳腺癌组织病理学数据集,通常用于乳腺癌分类。它是由乳腺组织活检片产生的,用苏木精和伊红(H&E)染色,并由巴西P&D医学实验室的病理学家标记[33]。BreakHis数据集由82例患者乳腺肿瘤组织的7909张显微图像(700 × 460像素,3通道RGB,每个通道8位深度,PNG格式)组成,放大倍率为40x、100x、200x和400x,对应的物镜为4×、10×、20×和40×。这些图像的子集包括2480张良性图像和5429张恶性图像。 使用80%的样本进行训练,20%的样本进行测试。

3.2 AE + SoftMax

AE + SoftMax作为基准网络,比较多尺度处理对输入图像提取特征可分性的影响。AE获取图像特征后,使用SoftMax分类器在不同尺度上验证提取的特征的有效性。此外,比较了不同放大倍数下输入图像在不同尺度下的分类性能。本实验的目的是为乳腺癌组织病理图像的分类确定一个合适的输入尺度。

在不同放大倍数(40×, 100×, 200×, 400×)下,特定的多尺度输入组合(1× + 2×, 0.5× + 1×, 0.25× + 0.5×, 0.125× + 0.25×)分别取得了更高的识别效果。这表明,由于图像放大倍数的不同,原始尺度也不同,因此最佳输入尺度组合也不同。

由于Siamese网络是一个特征对输入,与不使用Siamese框架的AE模型相比,训练时间的成本实际上增加了。然而,与其他模型相比,模型在性能上有了很大的提高。

4. 讨论

(1)合适的尺度特征有助于对组织病理图像中的乳腺肿瘤进行分类。工作中使用了多尺度输入来学习不同尺度下的全局和局部特征信息。在更精细的尺度上提取图像特征,可以解决神经网络感知场固定的问题。实验结果进一步验证了对多尺度输入的考虑。不同尺度的多重输入组合,对乳腺癌的组织病理学识别均有不同程度的提高。此外,我们的研究结果表明,在不同的放大倍数下,乳腺癌的组织病理学图像在连续的尺度变化中具有最大的识别改善。然而,如何找到最优的尺度组合仍然是一个值得考虑的问题。

(2)如果所提取的特征在类内的距离尽可能小,而在类之间的距离尽可能大,则有利于分类器性能的提升。为了进一步提高乳腺病理图像的性能,使用两个具有共享权重和偏差参数的AE作为所提出的Siamese网络的基准。这使得分类器能够更好地区分乳腺的良性和恶性组织病理图像。

5. 总结

提出了一种使用Siamese框架约束作为特征提取器的AE,用于构建乳腺癌组织病理图像分类的端到端网络模型。该模型旨在通过最小化输入和输出图像之间的距离来学习有用的图像特征,同时保持特征提取的类间距离尽可能大,类内距离尽可能小。

该模型将AE网络强大的特征提取能力与Siamese框架的特征距离约束相结合,获得更容易判别的图像特征。此外,输入图像的多尺度变换使网络模型能够同时学习全局和局部信息。实验结果表明,从多尺度输入中提取的特征可以显著提高分类性能,特别是当使用Siamese框架进行特征距离约束时。我们的模型不仅准确率高,而且在不同的病例中表现出良好的特异性、敏感性和较少的训练时间,这表明它对病理学家和研究人员在乳腺癌诊断中特别有用。