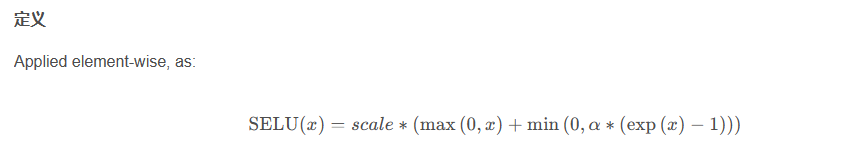

torch.nn.SELU

原型

CLASS torch.nn.SELU(inplace=False)

torch.nn.SELU 是 PyTorch 中的一个激活函数,它代表了自归一化的整流线性单元(Scaled Exponential Linear Unit)。SELU 激活函数相比于其他常用的激活函数具有一些特别的属性,例如能够自动缩放输出和保持均值接近于 0。

参数

- inplace (bool, optional) – 可选的是否为内部处理. 默认为

False

以下是关于 torch.nn.SELU 的一些教程:

-

创建一个包含 SELU 激活函数的神经网络:

import torch

import torch.nn as nnclass Net(nn.Module):def __init__(self):super(Net, self).__init__()self.fc1 = nn.Linear(10, 20)self.selu = nn.SELU()self.fc2 = nn.Linear(20, 1)def forward(self, x):x = self.fc1(x)x = self.selu(x)x = self.fc2(x)return x# 初始化模型

model = Net()# 使用 SELU 激活函数进行前向传播

input = torch.randn(5, 10) # 输入数据

output = model(input)2.自定义 SELU 激活函数的参数:

import torch

import torch.nn as nnclass CustomSELU(nn.Module):def __init__(self, alpha=1.67326, scale=1.0507):super(CustomSELU, self).__init__()self.alpha = alphaself.scale = scaledef forward(self, x):return self.scale * nn.functional.selu(x, self.alpha)# 初始化自定义 SELU 激活函数

selu = CustomSELU(alpha=1.5, scale=1.2)# 使用自定义 SELU 激活函数进行前向传播

input = torch.randn(5, 10) # 输入数据

output = selu(input)SELU 激活函数是深度神经网络中的一种常用激活函数,它具有一定的优势和特性。在使用 SELU 激活函数时,建议结合具体的网络架构和任务需求进行调整和实验。

Lnton 羚通是专注于音视频算法、算力、云平台的高科技人工智能企业。 公司基于视频分析技术、视频智能传输技术、远程监测技术以及智能语音融合技术等, 拥有多款可支持 ONVIF、RTSP、GB/T28181 等多协议、多路数的音视频智能分析服务器 / 云平台。